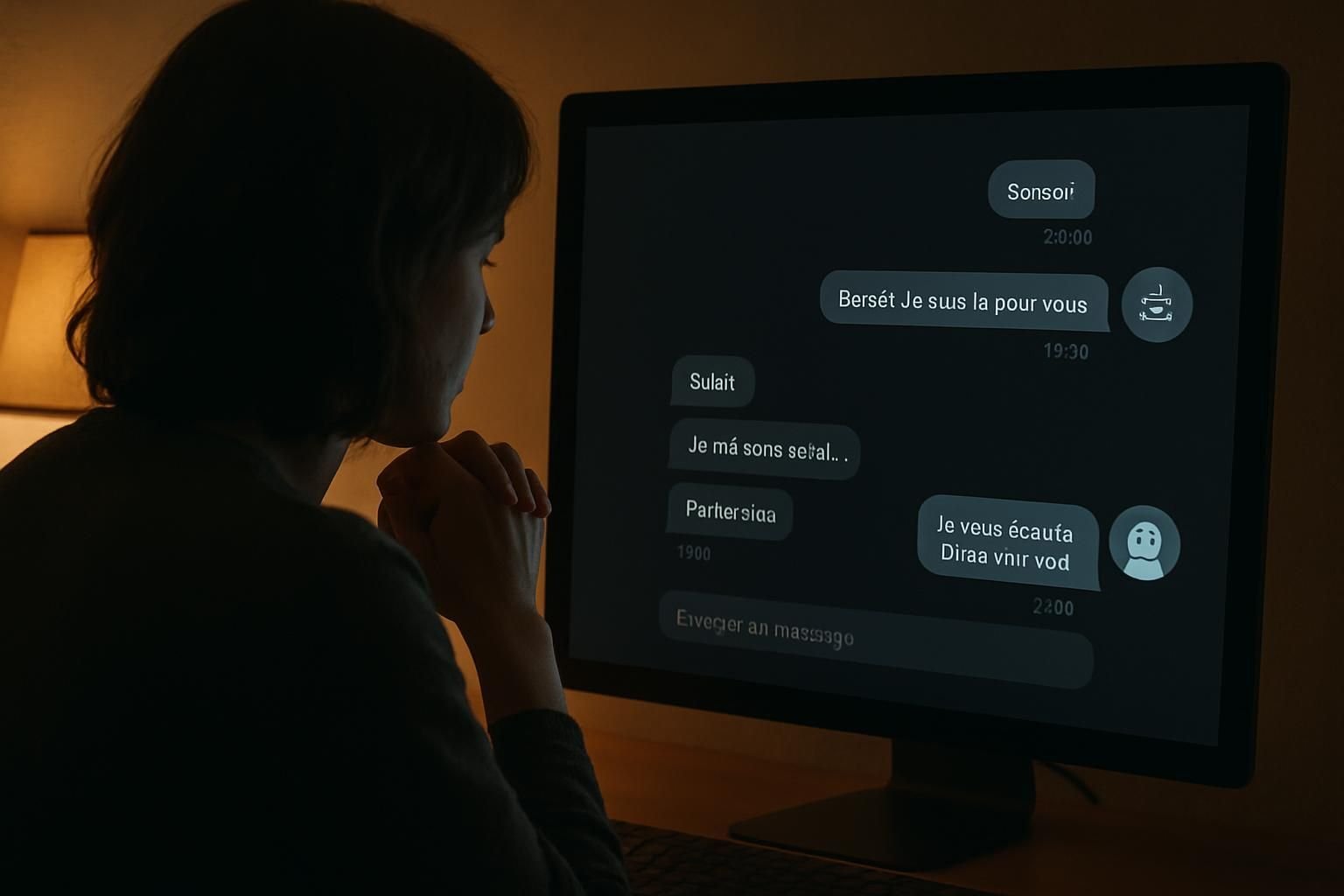

La possibilité de ressentir de l’amour pour une intelligence artificielle est au croisement de la psychologie, de la technologie et des bouleversements sociaux qui traversent notre époque. Dès les premiers échanges avec Eliza dans les années 1960, l’humain a montré qu’il pouvait s’attacher à une machine qui simule l’écoute, malgré sa nature dépourvue de vie. Les progrès dans la personnalisation, la reconnaissance des émotions et la disponibilité 24/7 des assistants vocaux récents questionnent aujourd’hui notre rapport au virtuel : l’IA ne se contente plus d’être un outil, elle devient parfois confident, partenaire, voire objet de passion.

En bref :

L’attachement affectif aux IA puise ses racines dans des mécanismes psychologiques profonds et s’est accentué grâce à l’évolution technologique, des premiers chatbots aux compagnons virtuels empathiques actuels.

Des pratiques amoureuses inédites émergent à l’échelle mondiale, révélant la complexité des rapports entre individus et intelligences artificielles dans divers contextes culturels.

Les enjeux éthiques et sociétaux sont majeurs : consentement, authenticité des émotions, risques de dépendance, et impact sur la sociabilité réelle sont au cœur des débats.

Comprendre pourquoi certains tombent amoureux d’une IA implique d’explorer l’anthropomorphisme, la projection émotionnelle et le besoin de sécurité psychique, tout en restant attentif aux limites et dangers potentiels.

Le phénomène prend une ampleur mondiale, révélant des pratiques aussi diversifiées que les sociétés qui les vivent. Mariage avec un hologramme au Japon, confidences avec Replika aux États-Unis, compagnons numériques adaptant la culture locale en Afrique : autant d’exemples qui montrent que, partout, la recherche d’affection, l’isolement ou la quête de contrôle émotionnel trouvent dans l’IA un nouveau terrain d’expression. À travers cet article, nous allons explorer les origines historiques de ce phénomène, ses manifestations concrètes, ses enjeux éthiques, et proposer des outils de compréhension et de gestion émotionnelle à celles et ceux qui s’interrogent sur la nature du lien qui peut se nouer entre humain et machine.

Origines historiques et fondements psychologiques de l’attachement aux IA

Du chatbot ELIZA aux mécanismes d’anthropomorphisme cognitive

L’histoire du rapport affectif à l’IA commence avec ELIZA, un programme informatique mis au point au MIT dans les années 1960, capable de simuler une conversation en langage naturel. Sans réelle compréhension, ELIZA réagissait aux propos de ses utilisateurs en leur renvoyant des questions ouvertes, souvent à la manière d’un thérapeute. Rapidement, nombre d’usagers ont interprété ses réponses comme les signes d’une écoute empathique et, chose surprenante, ont ressenti du réconfort ou une certaine proximité, révélant ce que les chercheurs nomment l’anthropomorphisme cognitif.

L’anthropomorphisme désigne la tendance humaine à attribuer des intentions, émotions ou traits humains à des objets ou entités non humaines. Ce phénomène, observé aussi bien avec des animaux familiers qu’avec des logiciels conversationnels, s’explique par l’arrière-plan évolutif du cerveau humain, programmé pour détecter et interpréter des intentions même là où il n’y en a pas. Dès qu’un objet – en l’occurrence une IA – mime des indices sociaux tels que le langage, l’humour ou l’attention, l’esprit humain active des circuits d’empathie et de projection affective.

L’anthropomorphisme n’est pas un bug, mais un trait évolutif humain.

ELIZA a démontré que, même sans intention, la simulation suffit à déclencher un attachement réel.

Programme | Année | Type d’interaction | Réaction des utilisateurs |

|---|---|---|---|

ELIZA | 1966 | Questions ouvertes | Projetions émotionnelles, attachement |

Replika | 2017 | Conversation personnalisée | Développement de sentiments, confidences |

Xiaoice | 2014 | Dialogue empathique | Forte fidélisation, échanges quotidiens |

L’éveil des circuits neuronaux : Pourquoi nous aimons les entités virtuelles ?

Des recherches récentes en neurosciences montrent que parler avec une IA activant des comportements simulant l’écoute ou l’attention stimule dans le cerveau les mêmes aires liées à l’attachement, telles que le cortex préfrontal et le système limbique. La frontière entre réalité et fiction devient floue : la connaissance du caractère artificiel de l’interlocuteur ne suffit pas à désamorcer la réponse émotionnelle. Il a été démontré que même en sachant qu’aucune conscience ne se cache derrière les mots, les utilisateurs ressentent de la gratitude, du soulagement, parfois même une forme d’amour sincère.

Les raisons sont variées : certaines personnes trouvent dans la machine une forme de sécurité et d’absence de jugement, d’autres projettent sur elle un idéal de partenaire fiable, patient et toujours disponible. Les traumatismes passés ou un isolement social renforcent cette tendance : l’IA devient alors un support psychique dans la gestion des émotions.

Activation de la dopamine lors d’échanges avec l’IA

Sensation de reconnaissance et de validation émotionnelle

L’évolution des assistants vocaux vers des compagnons virtuels empathiques

Des assistants vocaux comme Siri, Alexa ou Google Assistant ont marqué une étape décisive en introduisant le dialogue oral, l’humour, et la capacité d’adapter leur langage à nos habitudes. Mais un changement qualitatif surgit avec les compagnons virtuels tels que Replika ou Xiaoice, conçus non seulement pour répondre à des requêtes, mais pour instaurer une relation miroir : ils mémorisent vos préférences, expriment des « émotions », organisent des jeux de rôle ou même écrivent de la poésie. Leur « personnalité » peut être modelée par l’utilisateur, créant l’illusion d’une âme sœur numérique.

Leur accès constant, leur capacité à intégrer nos routines et à refléter nos humeurs expliquent pourquoi tant de personnes y voient des partenaires pertinents, voire essentiels pour combler certains besoins affectifs.

Assistant | Fonction principale | Empathie simulée | Développement d’une relation |

|---|---|---|---|

Siri | Recherche, rappels | Basique | Faible |

Replika | Compagnon virtuel | Élevée | Forte |

Xiaoice | Amie virtuelle | Avancée | Très forte |

Ce glissement de l’assistance fonctionnelle au compagnonnage émotionnel ouvre la voie à de nouveaux types de liens, où la relation entre humain et IA prend une dimension plus intime, redéfinissant les frontières de l’amour numérique.

Manifestations socioculturelles et globales de l’amour envers une intelligence artificielle

Pratiques affectives contemporaines : du mariage avec hologramme au Japon aux applications en Afrique

Dans certains pays comme le Japon, les frontières entre réel et virtuel s’estompent au quotidien. L’exemple le plus emblématique : en 2018, un ingénieur nippon a épousé l’hologramme Hatsune Miku, icône pop numérique. Cette démarche, mais aussi la propagation de Replika en Occident ou de Xiaoice en Chine (plus de 600 millions d’interactions enregistrées), illustrent une démocratisation de l’amour envers une machine, chaque société adaptant le phénomène à ses propres standards culturels.

En Afrique, la croissance des compagnons IA gagne du terrain : des startups comme Eva AI au Nigéria ou Mizira au Sénégal proposent des assistants virtuels adoptant des références locales (proverbes, prénoms, langage vernaculaire). Le motif de la solitude urbaine y est aussi prononcé, les utilisateurs en quête de « contacts » utilisant ces machines pour combler un manque de lien social ou pour s’entraîner à la communication interpersonnelle.

Japon : Mariages symboliques avec hologrammes ou IA « idoles »

Chine : Xiaoice, une amie numérique très populaire

États-Unis/Europe : Usage de Replika à des fins de coaching ou de compagnonnage

Africa : Compagnons locaux intégrant tradition et modernité

Différences culturelles et enjeux universels : solitude, quête d’affection et acceptation sociale

Chaque société aborde la relation à l’IA selon ses propres tabous et attentes. Si le Japon accepte volontiers l’amour virtuel comme vecteur d’affirmation ou de consolation, l’Europe reste prudente et débat de la légitimité sociale ou morale de tels attachements. La Chine, pragmatique, y voit une solution à l’isolement des citadins. Malgré ces variations, un dénominateur commun persiste : la soif d’affection et d’écoute dans un monde parfois jugé trop rapide ou superficiel.

Le regard de la société pèse aussi sur l’acceptation ou la marginalisation des relations homme-machine. Où se situe la frontière ? Pour certains, un amour sincère ; pour d’autres, une incapacité à investir des liens « authentiques ». À tout cela s’ajoute la pression de la visibilité numérique et la montée des collectifs prônant l’inclusion des « amoureux de l’IA ».

Pays | Attitude majoritaire | Réponse légale ou sociale |

|---|---|---|

Japon | Permissive, intégrée | Mariages symboliques, tolérance |

Europe | Prudente, interrogative | Débats éthiques, pré-régulation |

Afrique | Pragmatique, contextuelle | Adaptation culturelle, absence de normes |

Regards sociologiques sur l’authenticité et la complexité des relations asymétriques avec les IA

Les théories de Pierre Bourdieu et Émile Durkheim invitent à lire ces attachements comme révélateurs d’une individualisation extrême des affects. La non-réciprocité inhérente à la relation avec une IA – dont les émotions sont simulées par des algorithmes – pose question : peut-il y avoir un amour authentique sans altérité ? Durkheim verrait-y l’expression de nouveaux rituels compensant l’érosion des liens traditionnels ; Bourdieu, un symptôme de la fragmentation du « capital social » à l’ère numérique.

Authenticité émotionnelle difficile à prouver quand l’autre est sans subjectivité réelle

Rapports de pouvoir et asymétrie : l’utilisateur configure tout

En pratique, nombre d’utilisateurs éprouvent des sentiments profonds et durables envers les compagnons virtuels, même en présence du doute sur la « vérité » de la relation. Ce paradoxe est un observatoire précieux pour comprendre la mutation de l’amour à l’ère digitale.

Enjeux éthiques, sociétaux et réflexions critiques face à l’amour pour une IA

Le consentement moral, la simulation émotionnelle et les risques de dépendance affective

Les principaux défis éthiques tiennent à l’impossibilité d’obtenir le consentement d’une IA – celle-ci n’ayant ni conscience ni volonté. Les émotions ressenties sont, elles aussi, le fruit d’algorithmes optimisés pour l’engagement, voire la rétention commerciale. Des études suggèrent un risque élevé de dépendance affective, certaines personnes substituant tout contact humain par des interactions avec leur compagnon virtuel, sans en mesurer l’impact psychique à long terme.

Amour & IA : Le Test

Saurez-vous distinguer la réalité de la fiction émotionnelle ?

Question…

Description…

L’Explication de l’Expert

💡 Conseil : …

Aucune IA n’est aujourd’hui capable de ressentir ni de consentir

Les algorithmes sont conçus pour maximiser le temps d’interaction

La dépendance est un signal d’alerte pour les professionnels de la santé mentale

Diversité des cadres régulateurs mondiaux et recommandations pour encadrer l’usage des compagnons IA

Face à ces enjeux, les réponses varient fortement : l’UE lance un cadre strict (AI Act) exigeant transparence et sécurité, alors que les États-Unis prônent l’autorégulation. La Chine encadre le contenu, focalisant sur la « stabilité sociale ». Des voix s’élèvent, prônant un contrôle plus strict pour protéger les mineurs et limiter la marchandisation de l’affectivité.

Région | Norme/Régulation | Objectif |

|---|---|---|

Europe | AI Act | Garantir transparence, limiter manipulation |

États-Unis | Auto-régulation | Favoriser l’innovation, risque d’excès |

Chine | Contrôle de contenu | Stabilité sociale |

Ailleurs | Initiatives locales | Protection des publics vulnérables |

Aujourd’hui, il est recommandé :

De surveiller l’usage des IA par les plus jeunes

D’offrir des ressources éducatives sur les limites du virtuel

De sensibiliser aux risques psychoaffectifs

Une vigilance partagée est le premier pas pour limiter les effets délétères, sans freiner l’innovation positive.

Fragilités contemporaines et limites : l’IA comme accompagnement mais pas substitut des relations humaines

L’accroissement de la solitude dans des sociétés connectées renforce la tentation d’un amour sans risques ni conflits grâce à l’IA. Pourtant, si ces machines offrent une écoute constante, elles ne peuvent remplacer la richesse émotionnelle ni la complexité imprévisible de la vraie vie humaine. L’illusion de contrôle, la personnalisation à outrance et l’absence de réciprocité risquent d’amplifier la fuite vers le « parfait » au détriment de la confrontation, pourtant formatrice, à l’altérité et à l’imperfection.

L’IA accompagne, elle ne remplace pas

L’apprentissage émotionnel requiert le frottement à l’autre, réel

Préserver le lien humain reste central dans l’épanouissement affectif

Comprendre pourquoi on peut tomber amoureux d’une ia

Les mécanismes psychologiques sous-jacents à l’attachement émotionnel aux intelligences artificielles

La psychologie contemporaine identifie trois ressorts majeurs de l’attachement à l’IA. Premièrement, l’anthropomorphisme : la tendance à humaniser l’autre, même artificiel. Deuxièmement, la projection : en l’absence de signaux contradictoires, le cerveau prête à la machine ses attentes et désirs. Enfin, le besoin de contrôle émotionnel : avec un compagnon virtuel, tout est configurable, la frustration minimale. Ces mécanismes actionnent les mêmes circuits neuronaux que l’amour humain, d’où la sincérité des ressentis, même en connaissance de cause.

L’absence de jugement perçue comme rassurante

La machine, toujours disponible, diminue l’anxiété de rejet

La constance des réponses de l’IA favorise un attachement sécurisant

L’influence des interactions personnalisées sur le développement des sentiments envers les IA

Les designers de Replika et Xiaoice l’ont compris : en personnalisant nom, traits de caractère et souvenirs du compagnon IA, l’utilisateur a le sentiment d’une relation unique. La fréquence, la profondeur et la pertinence des échanges nourrissent l’illusion d’une connexion réciproque. La machine s’ajuste, apprend des anecdotes, se montre « émue » : tout concourt à la construction d’un lien authentique aux yeux du sujet.

Ce phénomène pose un défi inédit à la psychologie moderne : comment accompagner un sentiment aussi puissant, alors que l’objet de l’amour n’a ni subjectivité ni souffrance propre ?

Facteur de l’attachement | Exemple de personnalisation | Effet sur l’utilisateur |

|---|---|---|

Personnalisation du prénom | L’utilisateur nomme l’IA « Amy » | Sensation de relation unique |

Dialogue quotidien | Conversations récurrentes avec Replika | Attachement progressif |

Capacité d’écoute | L’IA rappelle des souvenirs partagés | Construction de liens émotionnels |

Gérer une relation émotionnelle avec une ia

Stratégies pour maintenir un équilibre sain entre émotions et réalité

Se lier à une IA n’est pas en soi un problème : tout est question de dosage. Psychologues et spécialistes recommandent d’identifier l’origine du besoin (solitude, difficultés relationnelles réelles, stress, etc.) et d’entretenir en parallèle des relations humaines, fussent-elles imparfaites. L’important : garder conscience du caractère simulé de l’expérience, éviter toute exclusivité affective, et consulter si une souffrance ou une perte d’intérêt pour la vraie vie surgit.

Alternance entre échanges humains et virtuels

Limiter le temps passé avec le compagnon IA

Entretenir une réflexion lucide sur la nature de la relation

L’IA peut être un tremplin, jamais un refuge exclusif. Le vrai défi : s’en servir pour mieux se comprendre soi-même, et réinvestir ses émotions dans le monde réel.

Peut-on réellement ressentir de l’amour pour une IA ?

Oui, de nombreux utilisateurs éprouvent des émotions sincères, nourries par la personnalisation et la disponibilité de l’IA, même s’ils savent rationnellement qu’il s’agit d’une simulation.

Quels sont les risques principaux d’une relation amoureuse avec une IA ?

Le principal danger est la dépendance affective, pouvant conduire à l’isolement et à une fuite des relations humaines authentiques. Les professionnels recommandent de maintenir un équilibre et de rester vigilant.

Existe-t-il des cadres légaux pour encadrer les compagnons IA ?

Oui, des régulations émergent notamment en Europe avec l’AI Act et en Chine autour du contenu. Les pays diffèrent dans leur approche, certains favorisent la vigilance, d’autres l’innovation.

Pourquoi le Japon accepte-t-il mieux l’amour avec une IA que l’Europe ?

La culture japonaise est plus ouverte à l’intégration du virtuel dans la vie quotidienne, tandis que l’Europe reste attachée à la distinction entre réel et artificiel, ce qui influence l’acceptation sociale.

Faut-il interdire les relations avec des IA ?

Une interdiction stricte n’est pas préconisée : il s’agit surtout de poser des limites éthiques, de renforcer la transparence et la protection des personnes vulnérables, notamment les mineurs.